Microsoft Research ha annunciato il rilascio di Phi-2, un modello linguistico di piccole dimensioni (SLM) che dimostra capacità notevoli per le sue dimensioni. Lanciato oggi, il modello è stato svelato per la prima volta durante l’evento Ignite 2023 di Microsoft, in cui Satya Nadella ha evidenziato la sua capacità di raggiungere prestazioni all’avanguardia con una frazione dei dati di addestramento.

A differenza di GPT, Gemini e altri modelli linguistici di grandi dimensioni (LLM), un SLM viene addestrato su un set di dati limitato, utilizzando meno parametri ma richiedendo anche meno calcoli per l’esecuzione. Di conseguenza, il modello non può generalizzare quanto un modello linguistico di grandi dimensioni, ma può essere molto buono ed efficiente in compiti specifici, come la matematica e i calcoli nel caso di Phi.

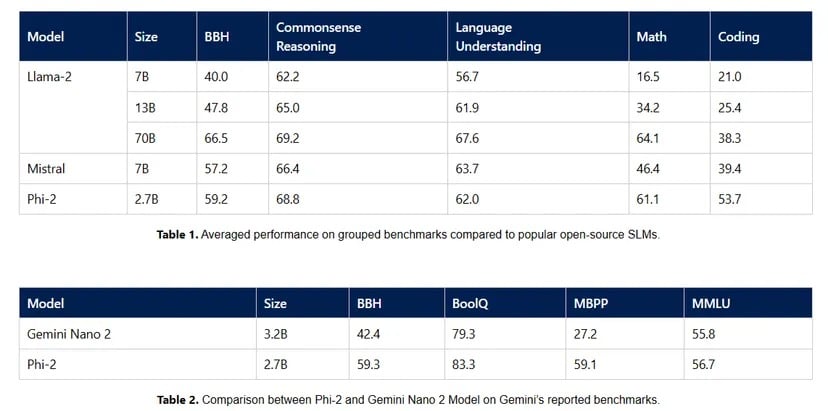

Phi-2, con i suoi 2,7 miliardi di parametri, dimostra una buona capacità di ragionamento e comprensione del linguaggio, rivaleggiando con modelli fino a 25 volte più grandi, secondo Microsoft. Ciò è dovuto all’attenzione di Microsoft Research per i dati di addestramento di alta qualità e per le tecniche di scalatura avanzate, che hanno permesso di ottenere un modello che supera i suoi predecessori in vari benchmark, tra cui matematica, codifica e ragionamento di buon senso.

“Con soli 2,7 miliardi di parametri, Phi-2 supera le prestazioni dei modelli Mistral e Llama-2 con 7B e 13B parametri su vari benchmark aggregati”, ha dichiarato Microsoft, lanciando un colpo basso al più recente modello di intelligenza artificiale di Google: “Inoltre, Phi-2 eguaglia o supera le prestazioni del Google Gemini Nano 2, annunciato di recente, nonostante le dimensioni più ridotte”.

Fonte: Microsoft

Gemini Nano 2 è l’ultima scommessa di Google su un LLM multimodale in grado di funzionare localmente. È stato annunciato come parte della famiglia Gemini di LLM che dovrebbero sostituire PaLM-2 nella maggior parte dei servizi di Google.

L’approccio di Microsoft all’intelligenza artificiale va comunque oltre lo sviluppo di modelli. L’introduzione di chip personalizzati, Maia e Cobalt, come riportato da TCN, dimostra che l’azienda si sta muovendo verso la piena integrazione dell’IA e del cloud computing. I chip, ottimizzati per le attività di IA, supportano la visione più ampia di Microsoft di armonizzare le capacità hardware e software e sono in diretta concorrenza con Google Tensor e la nuova serie M di chip di Apple.

È importante notare che Phi-2 è un modello di linguaggio così piccolo che può essere eseguito localmente su apparecchiature di basso livello, anche potenzialmente smartphone, il che apre la strada a nuove applicazioni e casi d’uso.

Poiché Phi-2 entra nel regno della ricerca e dello sviluppo dell’IA, la sua disponibilità nel catalogo di modelli di Azure AI Studio è anche un passo verso la democratizzazione della ricerca sull’IA. Microsoft è una delle aziende più attive nel contribuire allo sviluppo dell’IA open source.

Mentre il panorama dell’IA continua a evolversi, Phi-2 di Microsoft è la prova che il mondo dell’IA non è sempre una questione di pensare in grande. A volte, il potere più grande sta nell’essere più piccoli e più intelligenti.