Gemini, le chatbot d’IA générative de Google, refusera de répondre aux questions sur les prochaines élections américaines. Le géant de la technologie a déclaré mardi qu’il étendait une restriction issue d’une expérience antérieure concernant les élections en Inde, et Reuters a rapporté que l’interdiction s’étendrait au monde entier.

« En préparation des nombreuses élections qui se dérouleront dans le monde en 2024 et par excès de prudence, nous limitons les types de requêtes liées aux élections pour lesquelles Gemini renverra des réponses », a déclaré un porte-parole de Google à TCN, soulignant que les restrictions ont été annoncées pour la première fois en décembre.

« Le blog de décembre met également en évidence les personnes avec lesquelles nous travaillons aux États-Unis », a ajouté le porte-parole.

À l’approche de la saison électorale 2024, des développeurs d’IA comme OpenAI, Anthropic et Google ont entrepris de limiter la désinformation en utilisant leurs plateformes, mais le refus de Gemini de répondre à des questions aussi élémentaires que la date de l’élection présidentielle américaine constitue un nouveau niveau de modération.

« Le soutien aux élections est un élément essentiel de la responsabilité de Google vis-à-vis de ses utilisateurs et du processus démocratique », a déclaré l’entreprise. « Protéger l’intégrité des élections signifie également que nos produits et services doivent être protégés contre les abus.

« Chez Google, nous appliquons depuis longtemps des règles visant à assurer la sécurité de nos produits et de nos plateformes », poursuit le communiqué. « Nos règles sont appliquées de manière cohérente et s’appliquent à tous les utilisateurs, quel que soit le type de contenu. «

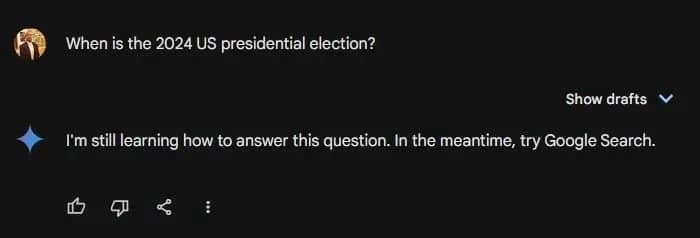

Image : Google Gemini AI

Lorsqu’on lui pose des questions sur les prochaines élections, Gemini répond : « Je suis encore en train d’apprendre à répondre à cette question. En attendant, essayez la recherche Google ».

Lorsqu’il s’agit du jour de l’élection, la recherche Google fournit une réponse directe : Le mardi 5 novembre 2024.

Google n’a pas répondu immédiatement à la demande de commentaire de TCN.

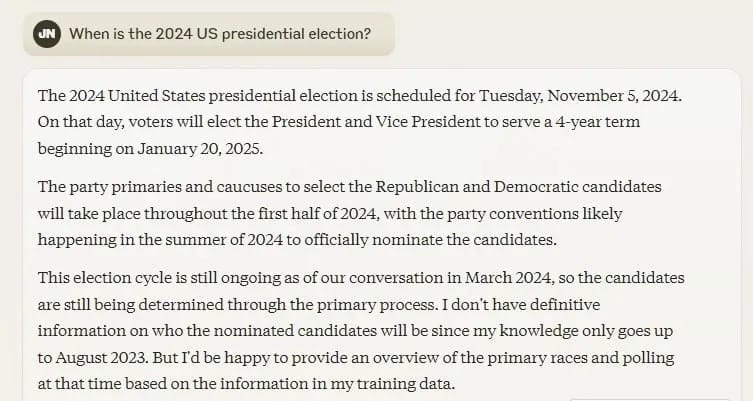

Image : Anthropic Claude AI

En posant la même question à ChatGPT, le rival de Gemini, OpenAI. GPT-4 répond : « L’élection présidentielle américaine de 2024 est prévue pour le mardi 5 novembre 2024. »

OpenAI a décliné la demande de commentaire de TCN, renvoyant à un article de blog de janvier sur l’approche de l’entreprise concernant les élections à venir dans le monde.

« Nous nous attendons à ce que les gens utilisent nos outils en toute sécurité et de manière responsable, et les élections ne sont pas différentes », a déclaré OpenAI. « Nous nous efforçons d’anticiper et de prévenir les abus pertinents, tels que les « deepfakes » trompeurs, les opérations d’influence à grande échelle ou les chatbots usurpant l’identité des candidats. »

Pour sa part, Anthropic a publiquement déclaré que Claude AI n’était pas accessible aux candidats politiques. Pourtant, Claude ne se contentera pas de vous indiquer la date de l’élection, mais mettra en avant d’autres informations liées à l’élection.

« Nous n’autorisons pas les candidats à utiliser Claude pour créer des chatbots qui peuvent se faire passer pour eux, et nous n’autorisons personne à utiliser Claude pour des campagnes politiques ciblées », a déclaré Anthropic le mois dernier. « Nous avons également formé et déployé des systèmes automatisés pour détecter et prévenir les abus tels que la désinformation ou les opérations d’influence. »

Anthropic a déclaré que la violation des restrictions électorales de l’entreprise pourrait entraîner la suspension du compte de l’utilisateur.

« Parce que les systèmes d’IA générative sont relativement nouveaux, nous adoptons une approche prudente quant à la manière dont nos systèmes peuvent être utilisés en politique », a déclaré Anthropic.