Percorremos um longo caminho desde o Adobe Flash e os postais electrónicos animados do JibJab.

Duas décadas depois, as pessoas com computadores e um pouco de tempo livre podem criar animações de alta qualidade (tanto de pessoas reais como de ilustrações) com apenas alguns cliques e sem conhecimentos de edição digital.

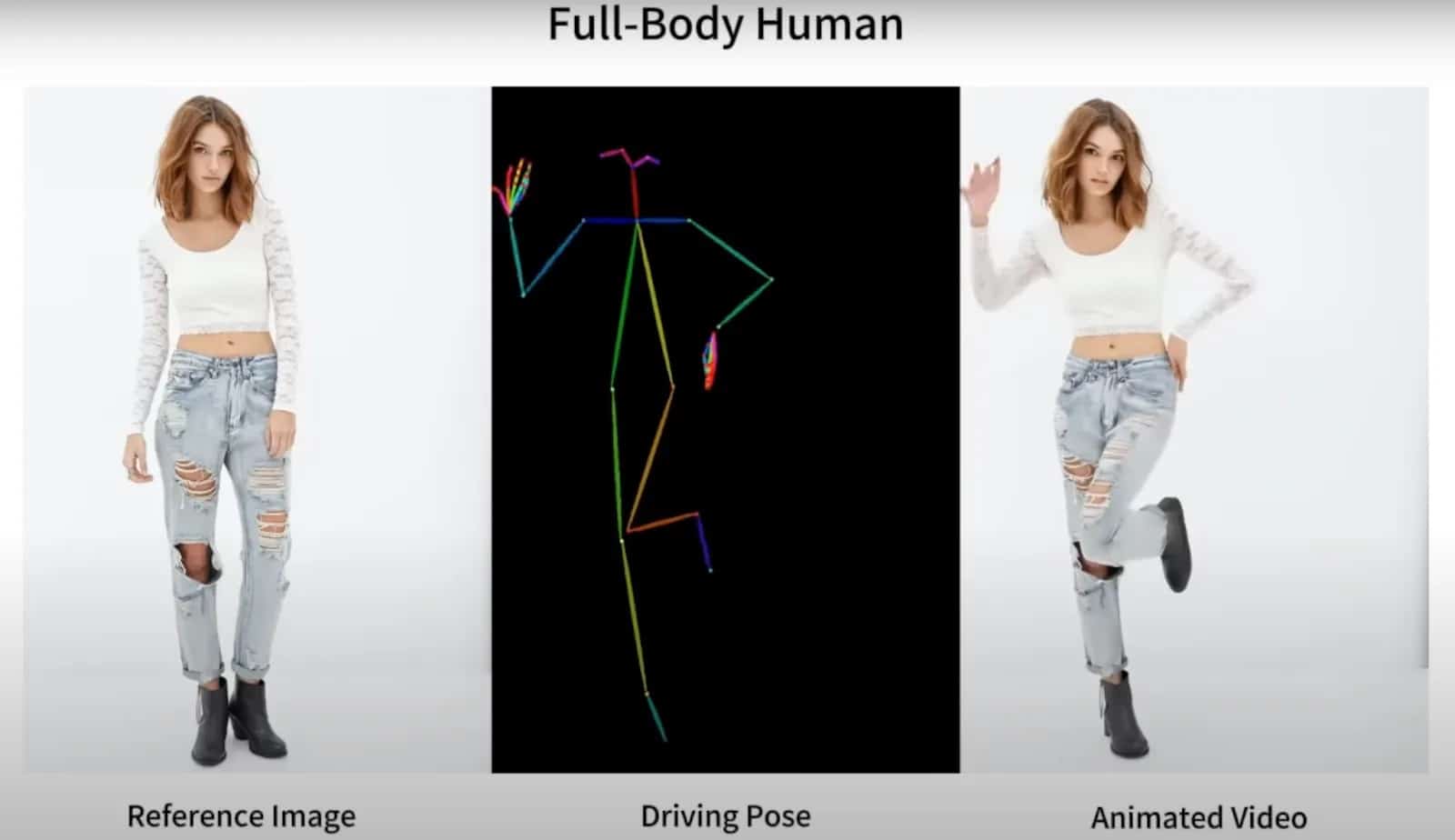

Esta é, pelo menos, a ideia de “Animate Anyone”, um modelo de IA introduzido pela equipa de investigação de IA da Alibaba, uma multinacional chinesa de tecnologia especializada em comércio eletrónico e tecnologia de retalho. E o vídeo da sua tecnologia em funcionamento – que afirma ser capaz de animar qualquer fotografia com uma consistência e um controlo notáveis – captou a imaginação de milhões de pessoas.

A Alibaba diz que o Animate Anyone pode transformar fotografias em vídeos “conforme controlado pelas sequências de pose desejadas e alcançando a continuidade temporal”, explicou a startup de avatares de IA MyCompanions no Twitter. “Menos falhas e sem dedos extra – muito fixe!”

A equipa acrescenta que esta tecnologia abre portas a novos casos de utilização entre os influenciadores: Roupas geradas por IA e a criação de um mercado para vídeos produzidos em massa, mas personalizados.

Vídeos curtos a partir de uma única fotografia? Em breve, vamos poder fazer isso para todos os nossos influenciadores!

Com base na mais recente pesquisa de ponta do grupo Alibaba, isto está quase a chegar. Porque é que esta tecnologia é importante? Como é que os influenciadores podem utilizar melhor esta tecnologia?

Tópico abaixo pic.twitter.com/C4QCJCeEXP

– MyCompanions (@MyCompanionsAI) 3 de dezembro de 2023

A página do modelo no GitHub foi inundada com pedidos de acesso ao código fonte. Em resposta, a equipa garantiu ao público que disponibilizará a demonstração e o código numa data ainda não especificada.

“Obrigado a todos pelo vosso incrível apoio e interesse no nosso projeto”, afirmou a equipa na última atualização do projeto no Github. “Queremos assegurar-vos que estamos a trabalhar ativamente na preparação da demonstração e do código para lançamento público.”

A declaração atraiu mais de 240 gostos em menos de um dia.

Se a demonstração em vídeo for correcta, o Animate Anyone pode ser utilizado para criar resultados de vídeo claros e temporalmente estáveis, mantendo a aparência da personagem de referência. Isto parece ser o resultado da integração de modelos de difusão numa nova estrutura chamada ReferenceNet, que pode fundir características detalhadas através da atenção espacial.

Para o conseguir, pega na imagem de referência, move as partes para seguir a pose desejada e, em seguida, preenche as lacunas que precisam de ser preenchidas para dar a ilusão de movimento consistente em cada fotograma do vídeo gerado. A chamada sequência openpose resulta numa animação quase perfeita.

O Animate Anyone também está a ser comparado com outras ferramentas de animação populares, como o AnimateDiff, o Warpfusion, o Deforum e o ebSynth. Estas ferramentas existentes muitas vezes não conseguem gerar quadros consistentes, o que facilita a identificação de vídeos como sendo gerados por IA. Em contrapartida, o Animate Anyone produz resultados mais refinados, em que os fotogramas são consistentes e a animação é quase indistinguível da realidade.

A equipa do Animate Anyone não respondeu a um pedido de comentário do TCN.

No meio do frenesim, no entanto, um modelo semelhante chamado MagicAnimate também surgiu como um concorrente sólido. Recentemente disponibilizado para testes locais, o MagicAnimate adopta uma abordagem ligeiramente diferente ao processo de animação. Embora não seja tão popular, o seu lançamento oferece uma alternativa para aqueles que pretendem explorar mais a fundo o domínio da animação baseada em IA.

MagicAnimate: Animação de imagens humanas temporalmente consistentes utilizando o modelo de difusão com @Gradio demo

demonstração local: https://t.co/ScsEU6oG64

Este artigo estuda a tarefa de animação de imagem humana, que tem como objetivo gerar um vídeo de uma determinada identidade de referência seguindo um determinado movimento… pic.twitter.com/JCOr0yCRZs

– AK (@_akhaliq) December 4, 2023

Em contraste com o Animate Anyone – que também usa um modelo de difusão, mas com foco em animação consistente com quadros e controlável a partir de imagens – o diferencial do MagicAnimate é melhorar a consistência temporal e a preservação da identidade. O seu codificador de aparência único e a sua técnica de fusão de vídeo conduzem a transições mais suaves em animações de vídeo longas e a uma melhor preservação de detalhes entre fotogramas.

Embora o MagicAnimate se destaque pela coerência temporal e pela qualidade por fotograma, não parece ser tão exato como o seu concorrente.

O antigo investigador da Meta AI, Alex Carliera, teve a oportunidade de testar o MaticAnimate e, embora o tenha apelidado de “um excelente primeiro passo para a geração de vídeo consistente a partir de uma única imagem”, notou que as gerações não eram 100% exactas em relação à imagem de referência, deformando o corpo em alguns fotogramas.

Testei o ControlNet para vídeo (MagicAnimate) e eis a minha opinião: funciona muito bem, mas tem algumas falhas.

– a identidade do vídeo em movimento passa para o vídeo resultante (e deforma a forma do corpo)

– mãos e rosto maus (o que não é surpreendente!)Mas um ótimo primeiro passo para ser consistente… https://t.co/zY9tZZ6MaK pic.twitter.com/J9XELE5NGT

– Alex Carlier (@alexcarliera) December 4, 2023

Portanto, se não sabes dançar e te sentes excluído da última coreografia do TikTok, talvez o Animate Anyone e o MagicAnimate possam ser o teu bilhete para o sucesso viral.